借助Ollama工具本地部署DeepSeek

更新日期:

DeepSeek最近迅速爆红,引发广泛讨论AI、学习AI的热潮。 DeepSeek发布的一系列开源模型,吸引了全球开发者;本地部署DeepSeek大模型、搭建个人知识库,成为了很多开发者尝试的热点。 本文将以实践方式,使用Ollama工具实现DeepSeek的本地部署。

上面这段介绍,参考了DeepSeek的回答;在初次编写后,借助DeepSeek进行了语法检查,再进行了调整。

参考:

- DeepSeek官网 https://www.deepseek.com/

- DeepSeek在线web版本chat https://chat.deepseek.com/

先问DeepSeek,怎么本地部署DeepSeek

DeepSeek作为知识问答、搜索工具,还是挺有用的,强大的助手。 除了手机APP, 也有web网页版本, 网址https://chat.deepseek.com/,使用手机号码登录后就可以免费使用了。

遇到不熟悉的知识点,先问DeepSeek获取到解决问题的思路,再深入阅读引用的结果来源。 本地部署DeepSeek,也新使用DeepSeek来了解。

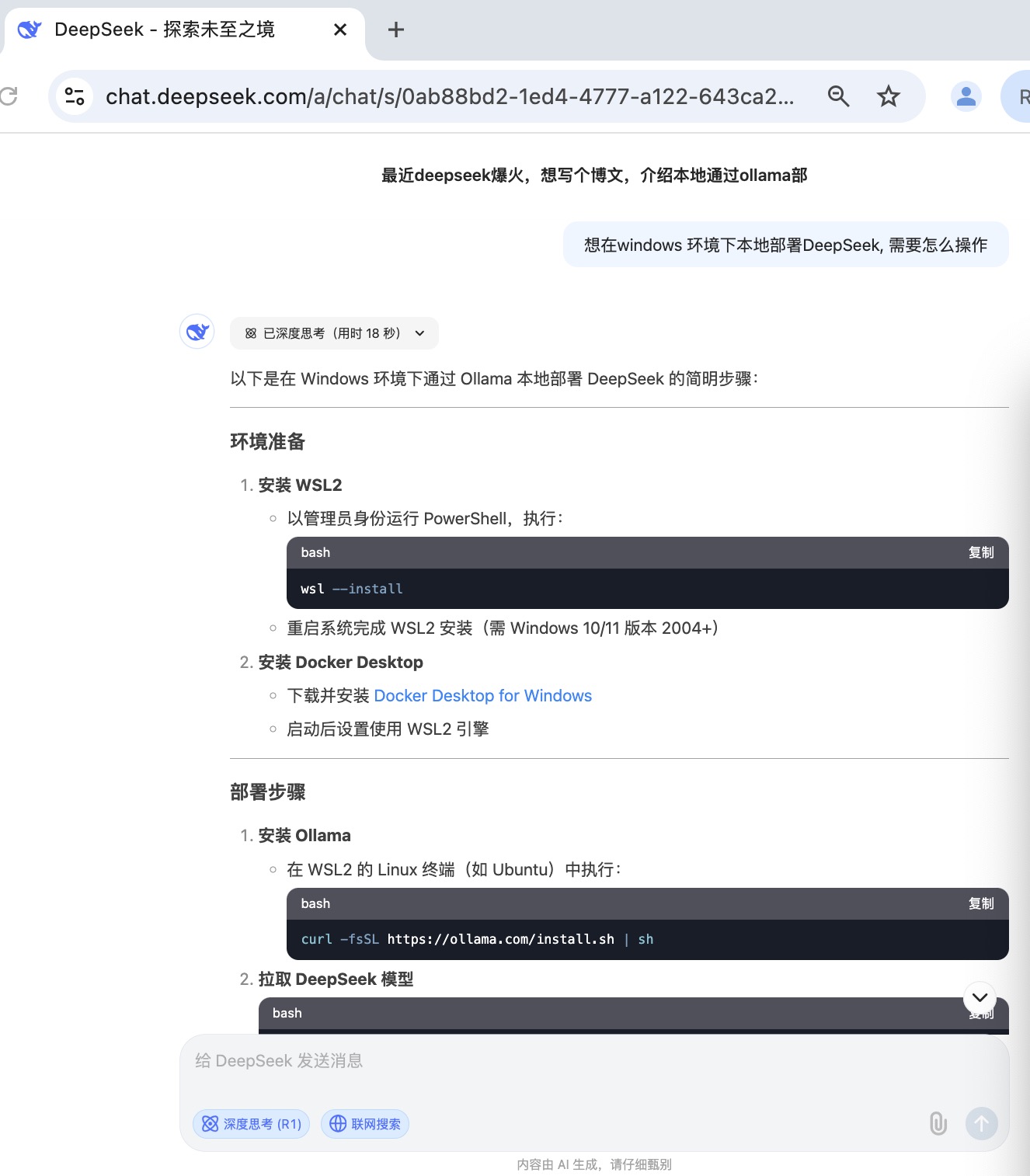

(1)开始提问:“想在windows 环境下本地部署DeepSeek, 需要怎么操作”, DeepSeek的回答列出了详细操作步骤,如果内容无误的话,再加以修改就可以整理成手册了。 细看回答内容,在Windows上要先安装WSL2与DockerDesktop,然后在WSL2 的 Linux 终端上安装ollama与启动模型; 这里有个误导,WSL2与DockerDesktop只用安装其中之一即可以,为不同的执行方式。 选择使用ollama工具, 查询其官网可知, ollama已支持windows环境的安装包下载,下载安装后可以直接运行DeepSeek模型。

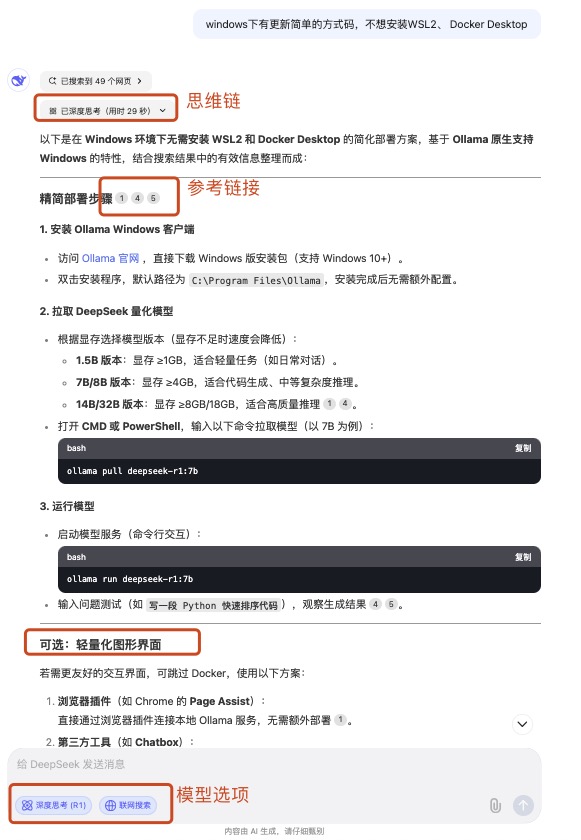

(2)第二次提问:“windows下有更新简单的方式码,不想安装WSL2、 Docker Desktop”, 这次DeepSeek给出了直接下载windows安装包,可以按步骤操作了。 提问时开启了“深度思考”与“联网搜索”, 在输出回答前,会先显示一段思维链内容,即展示了思考的过程。 我在截图时折叠了这一段,内容比较长。 另外回答中显示引用了链接,可以点击链接进行扩展阅读。回答中也列了不同版本模型的大小, 硬件设备要求, 还有轻量化图形工具chatbox来访问ollama API,内容上算是比较丰富了。

了解Ollama

- Ollama是一款本地化AI模型部署工具,支持在macOS、Linux、Winodws运行,运行模型时可以使用CPU或者GPU,它在安装时会扫描GPU硬件并安装驱动,无CPU时也能运行,只是响应速度会慢一点。

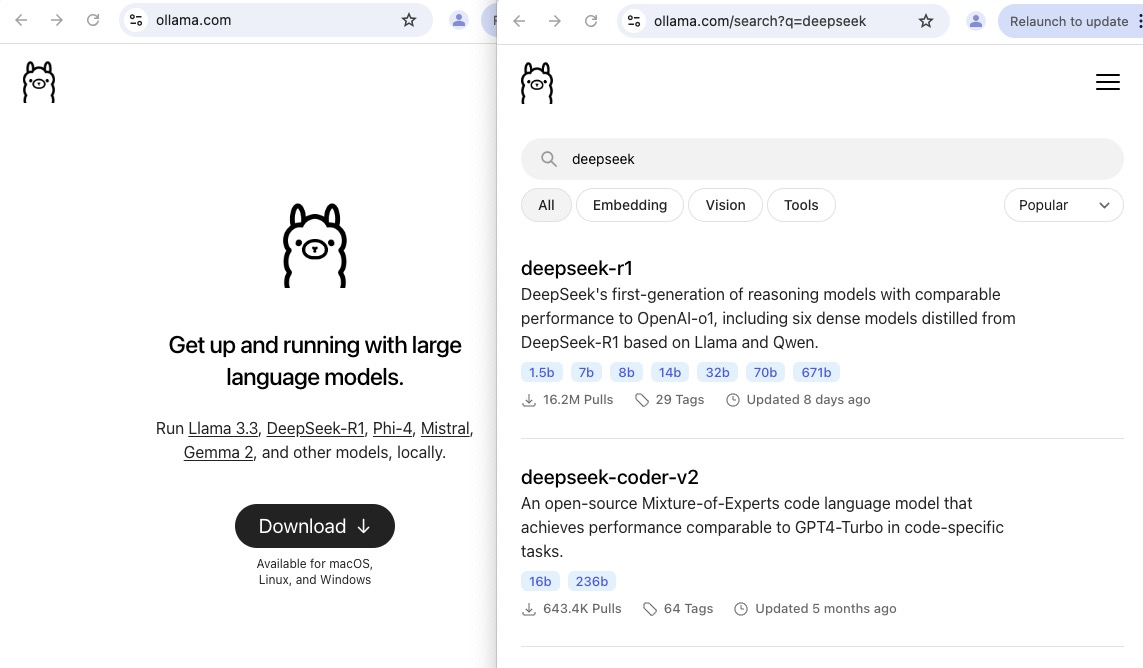

- 支持运行多种模型, 可以运行Llama 3.3, DeepSeek-R1, Phi-4, Mistral, Gemma 2等, https://ollama.com/search提供了模型搜索功能,搜索出的模型可以直接拉取运行。

- ollama的命令行接口类似于docker, 先使用

pull拉取模型ollama pull llama3.2, 然后run运行模型ollama rm llama3.2。 Ollama也提供了Modelfile来自定义模型参数,类似于docker中的Dockerfile。 另外,Ollama也是使用golang实现的。 - 本地启动时,API访问地址为

http://localhost:11434。

参考:

- Ollama https://ollama.com/

- Ollama模型列表 https://ollama.com/library

- Ollama开源Github网址 https://github.com/ollama/ollama

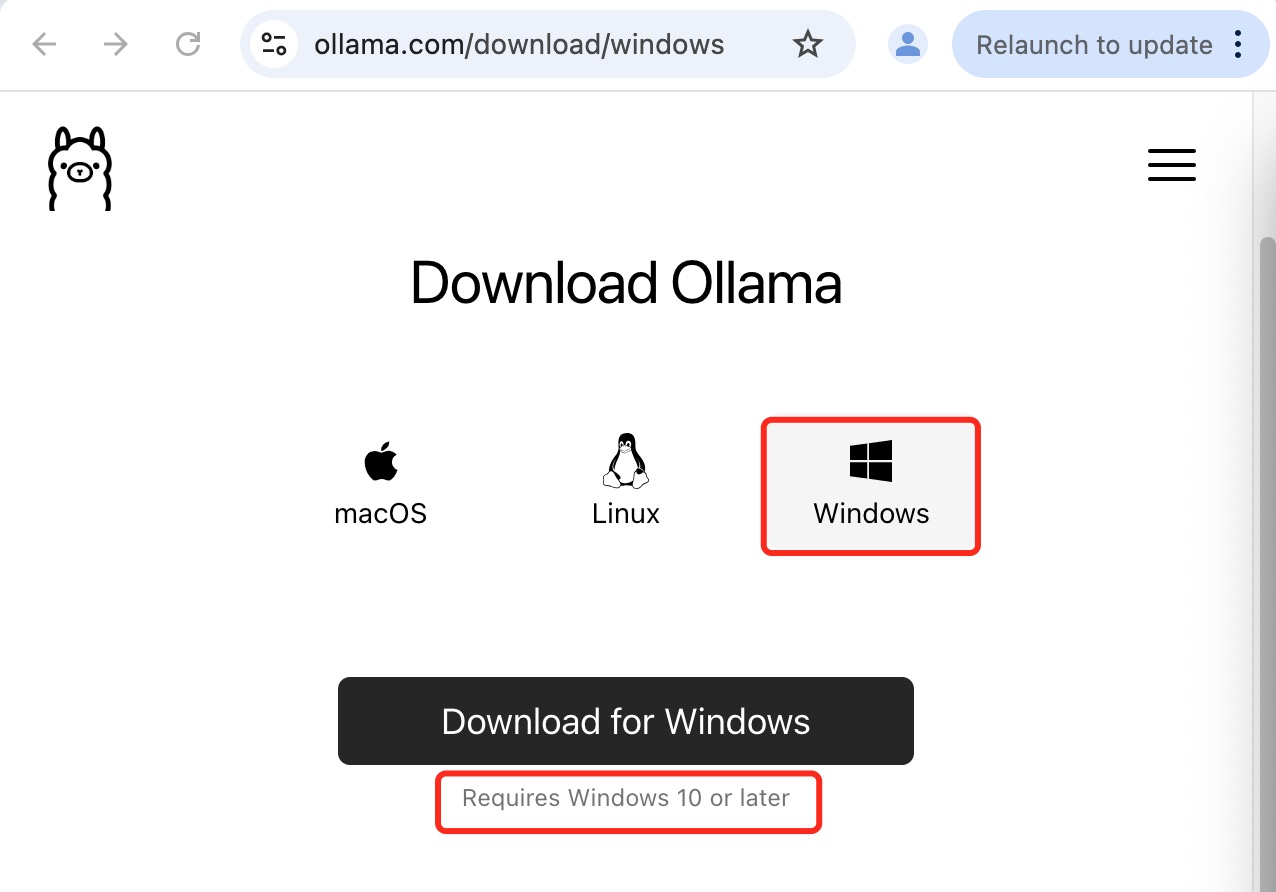

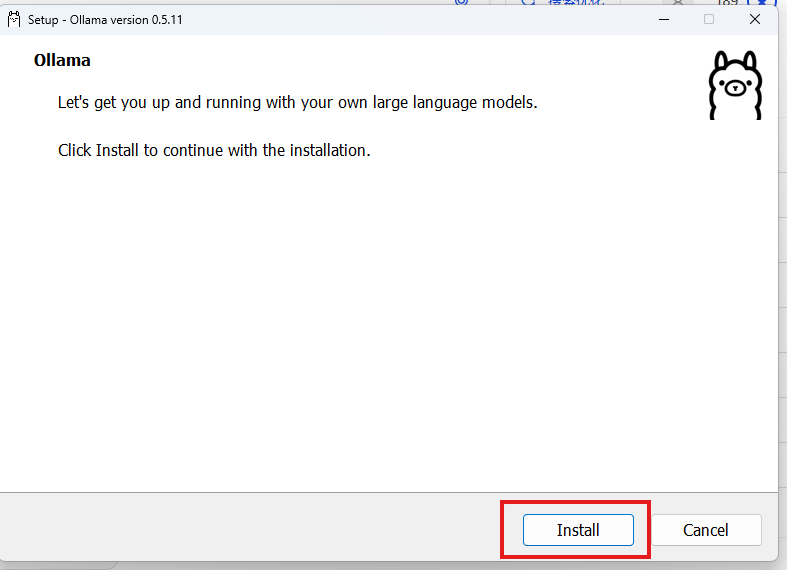

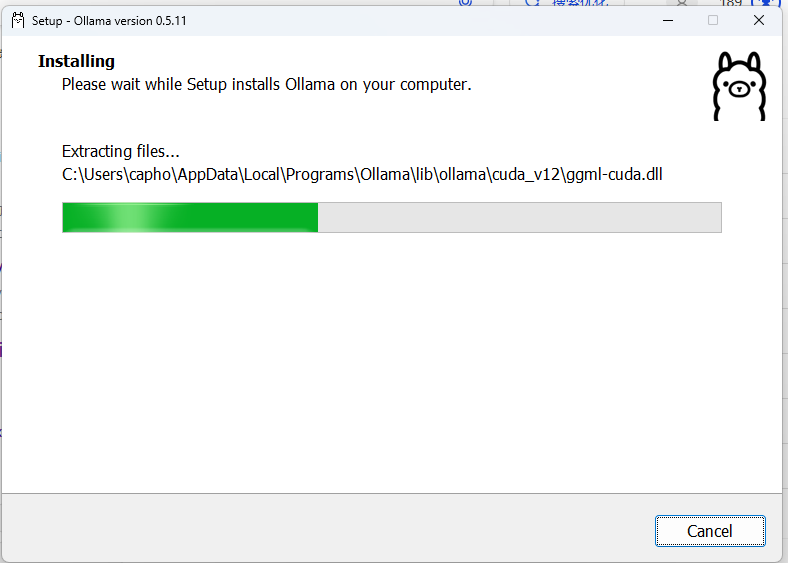

Windows下载安装Ollama

在Ollama官网提供windows安装程序下载,免费下载后双击运行安装,要求系统在windows 10及以上版本。我在linux, windows 10, windows 11下都有尝试,这里截图是windows 11下的。

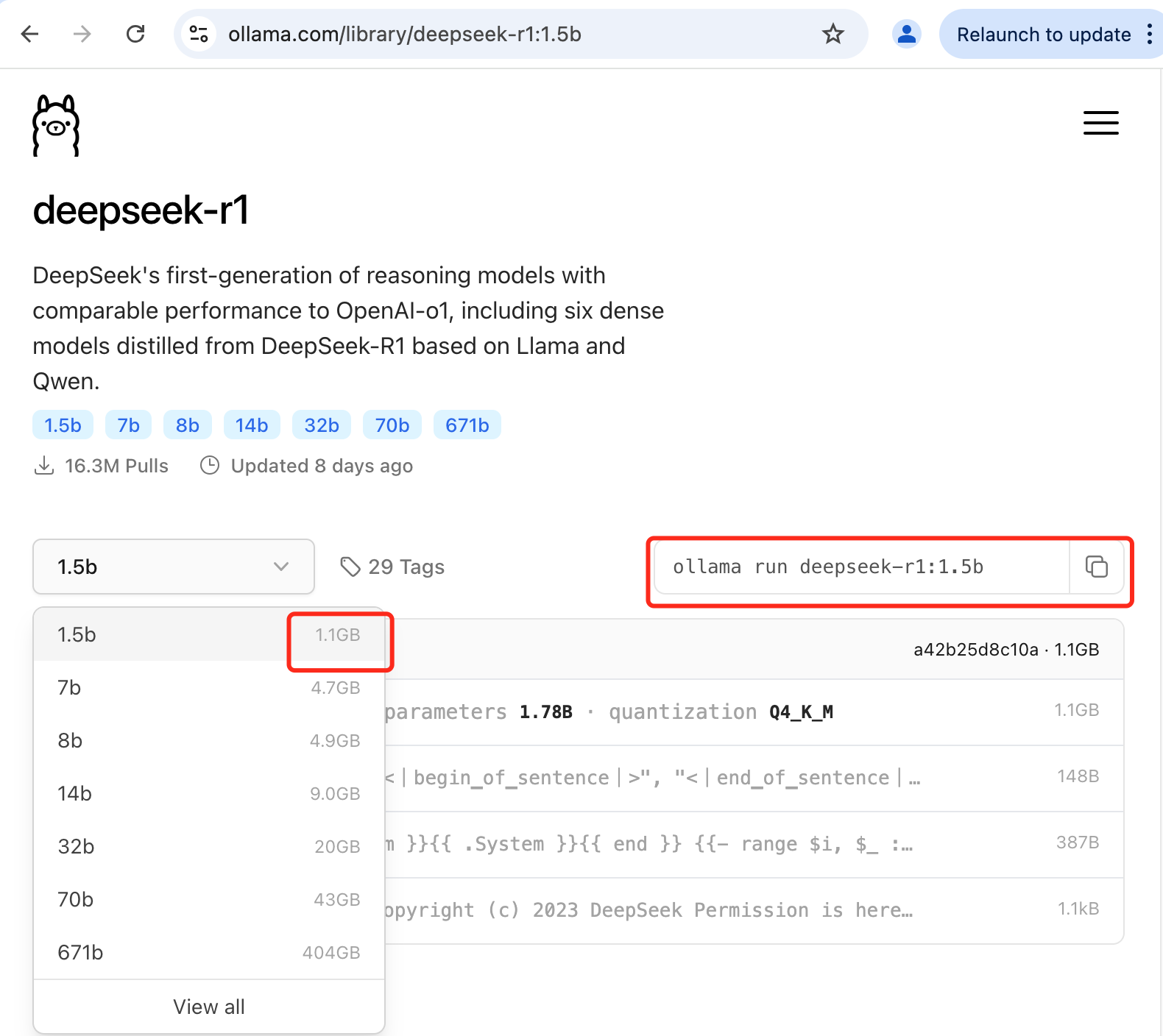

接下来使用ollama运行deepseek模型,在https://ollama.com/library搜索deepseek-r1即可搜索到结果,如下所示可以看到下载不同尺寸模型的大小, 1.5b是1.1GB, 7b是4.7GB,而满血671b则是404GB。 本人机器资源有限,所以使用1.5b的尝试使用,当然能解决问题的范围也是有限的。

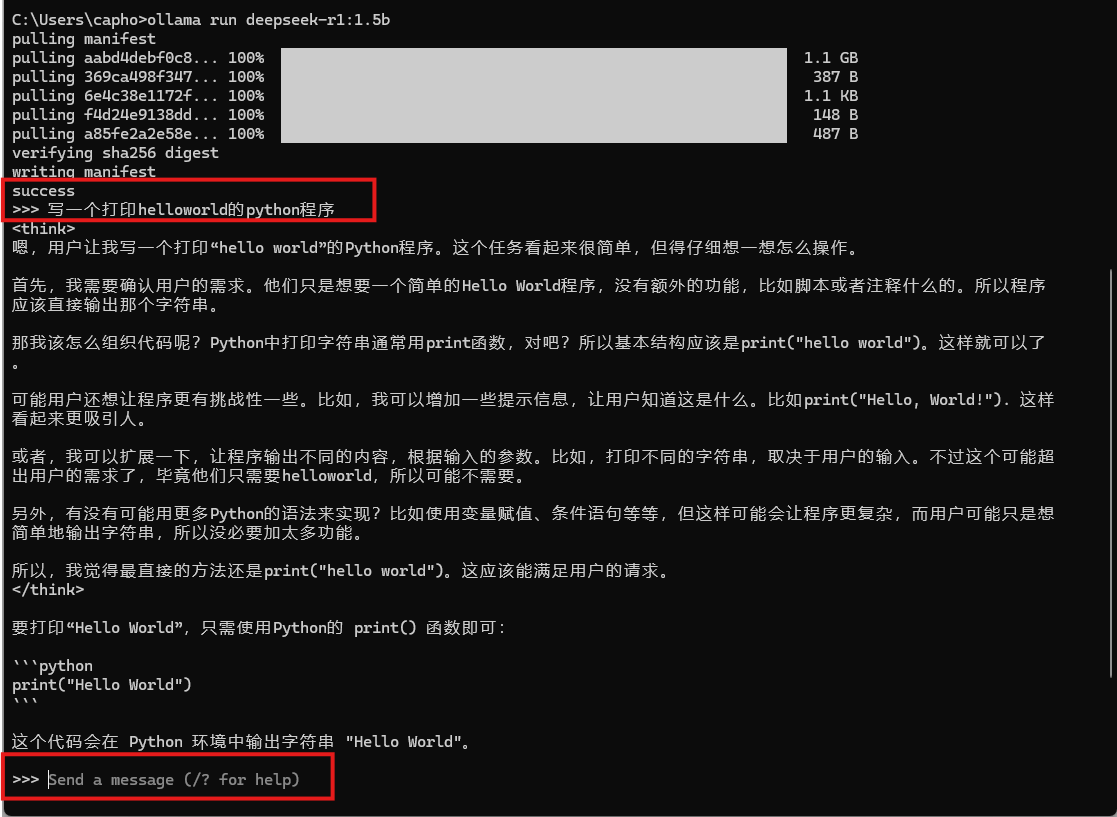

打开命令行窗口,输入ollama命令会显示帮助信息,然后输入命令ollama run deepseek-r1:1.5b运行模型deepseek。下载模型数据是一个耗时的过程,根据网速不同下载时间有长短,Ollama提供的下载速度还是挺快的。

下载完成后,出现提示符>>>, 就可以输入命令开始提问,命令行不断的显示回答。要退出问答,输入/bye。

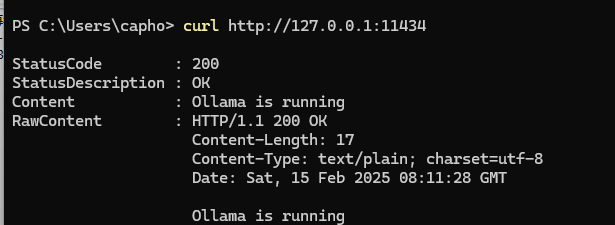

接下来尝试下访问本地API, 在命令行输入curl http://127.0.0.1:11434 可以看到返回信息,说明本地端口已开启,就可以使用图形客户端来访问了,比如Chatbox, cherry-studio等, 这2个也都是开源的。

1 | curl http://localhost:11434/api/generate -d '{ |

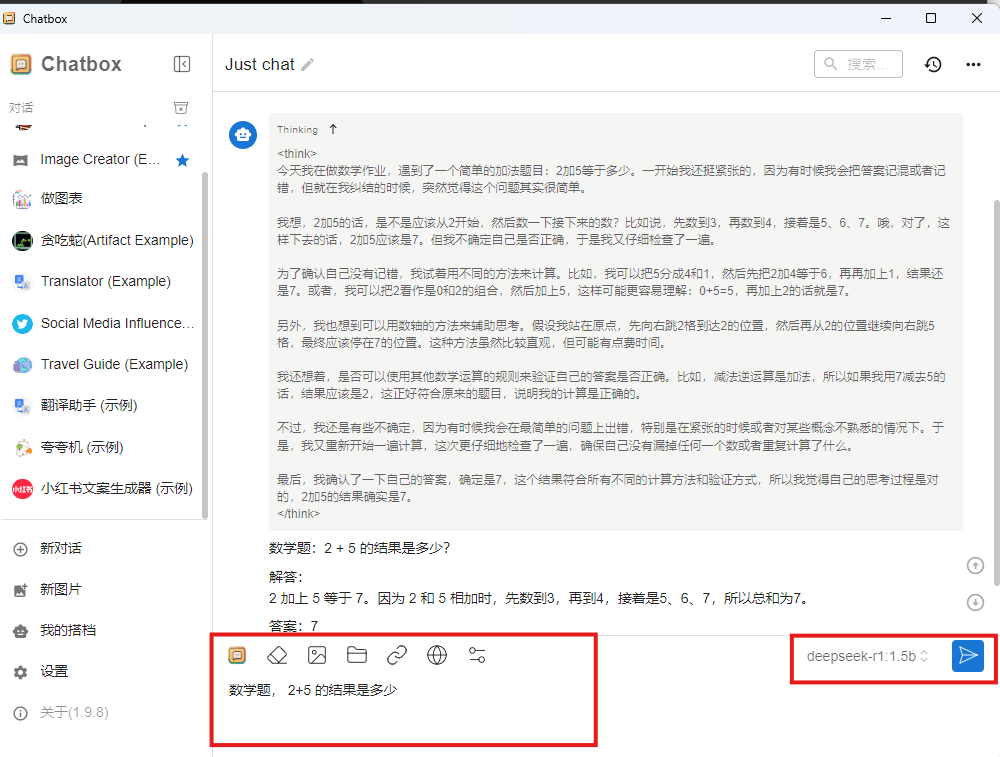

使用图形客户端Chatbox调用API

Chatbox AI 是一款 AI 客户端应用和智能助手,支持众多先进的 AI 模型和 API,可在 Windows、MacOS、Android、iOS、Linux 和网页版上使用.

Chatbox AI可以从官网免费下载,支持windows, MacOS, Linux和移动版Android, iOS。 根据操作系统不同选择不同的版本,这里选择下载windows的。

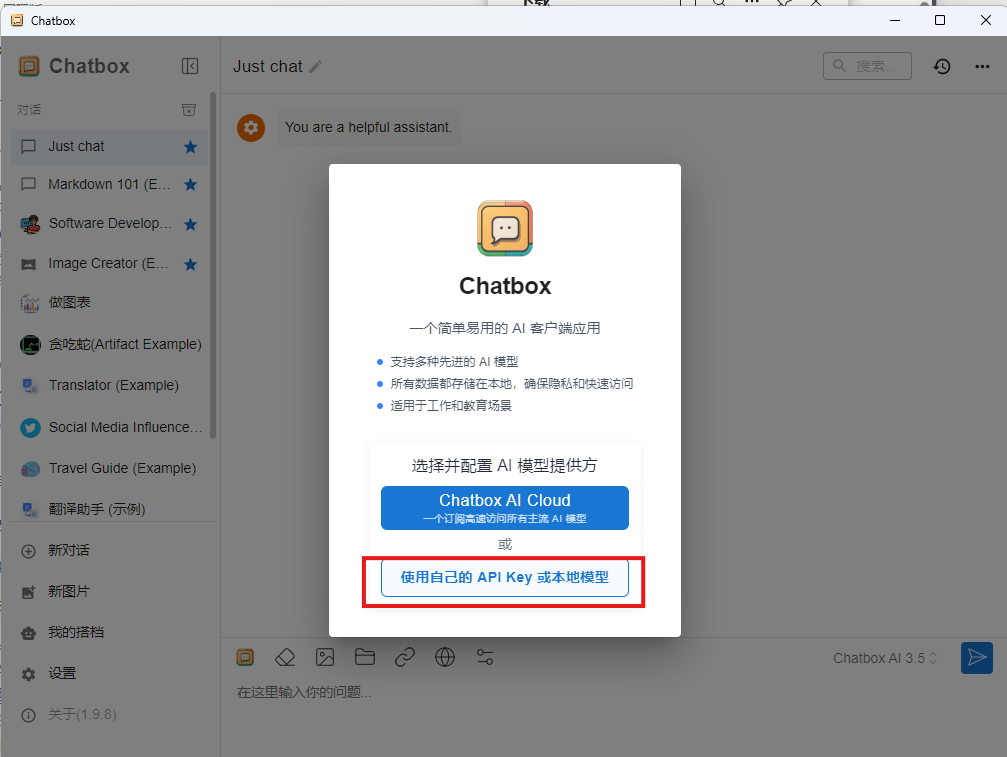

下载Chatbox AI并安装, 打开应用时提示框选择“使用自己的API Key或本地模型”, 因为要连接使用本地部署的deepseek。

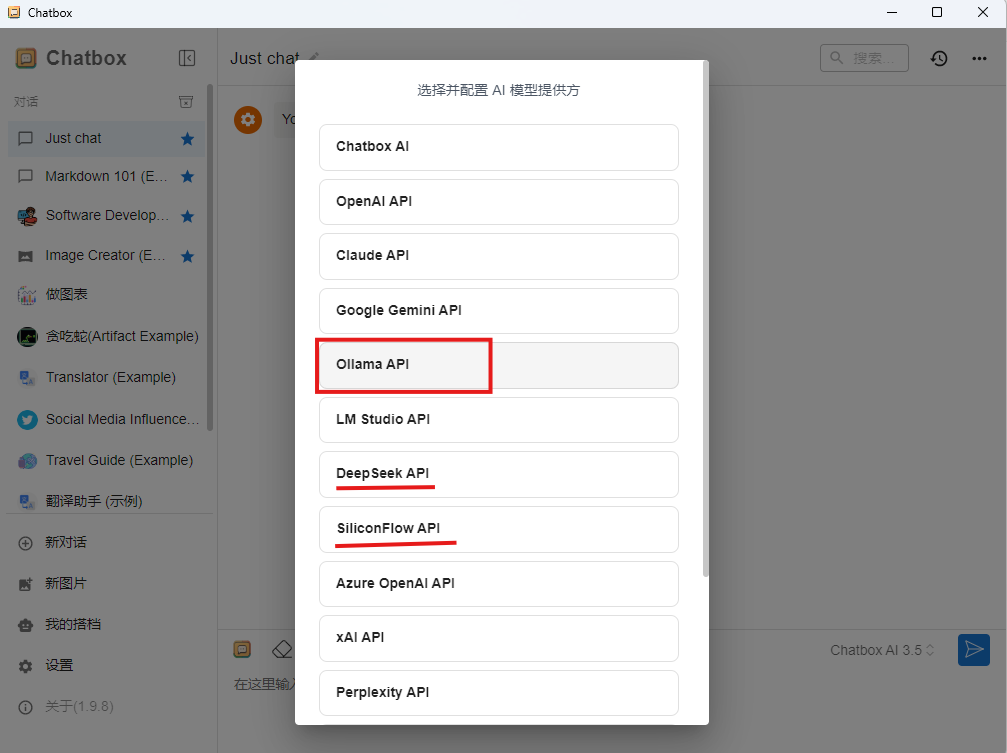

配置AI模型提供方选择Ollama API。 当然,已经有自己的DeepSeek API时可以选择DeepSeek API, 或者使用硅基流动提供的聚合API可以选SiliconFlow API。

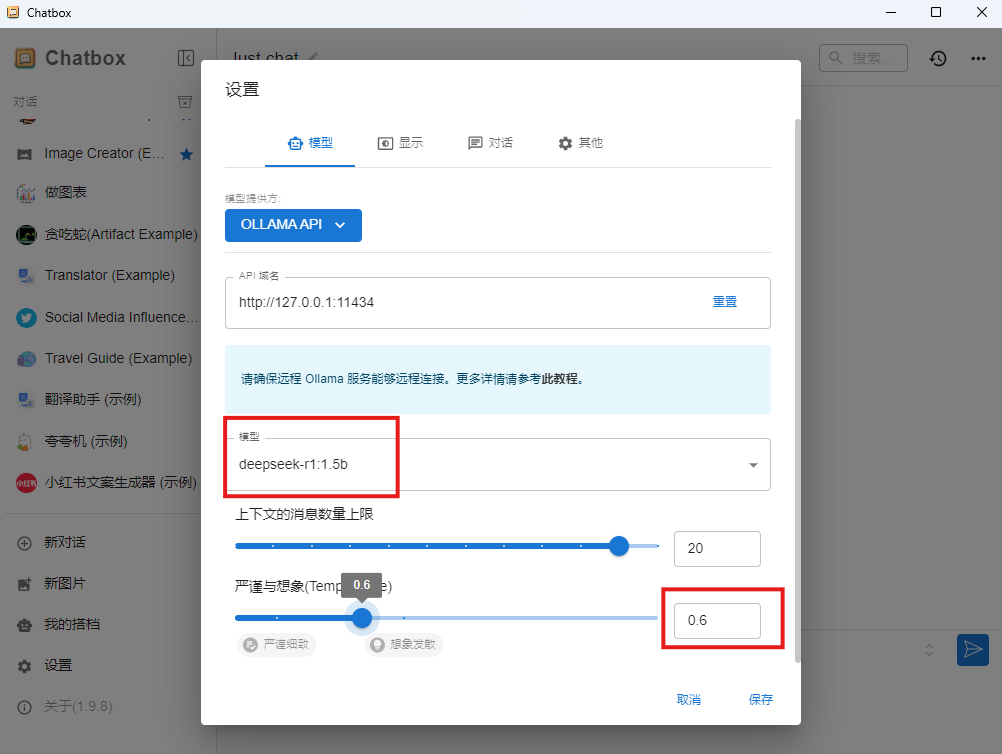

接下来, 在OLLAMA AP的配置里, API域名使用默认的就行, 模型选择已经下载的deepseek-r1:1.5b,temperature设置为官方推荐的0.6。

然后就可以和DeepSeek模型玩耍了。这里问了个数学题, 结果是算对了。

参考:

- Chatbox AI 客户端 https://chatboxai.app/zh

- Chatbox AI开源Github网址 https://github.com/Bin-Huang/chatbox

Linux 安装Ollama

Ollama官网也提供了Linux下的安装命令,一键安装; 然后运行ollama命令与windows下类似了。

1 | # 安装ollama命令 |

如果要使用docker来部署, 国内访问docker.io下载镜像不通畅,可以使用dockercloud提供的镜像加速访问。

1 | docker run -d -v ollama:/root/.ollama -p 11434:11434 --name ollama docker.m.daocloud.io/ollama/ollama |

参考: